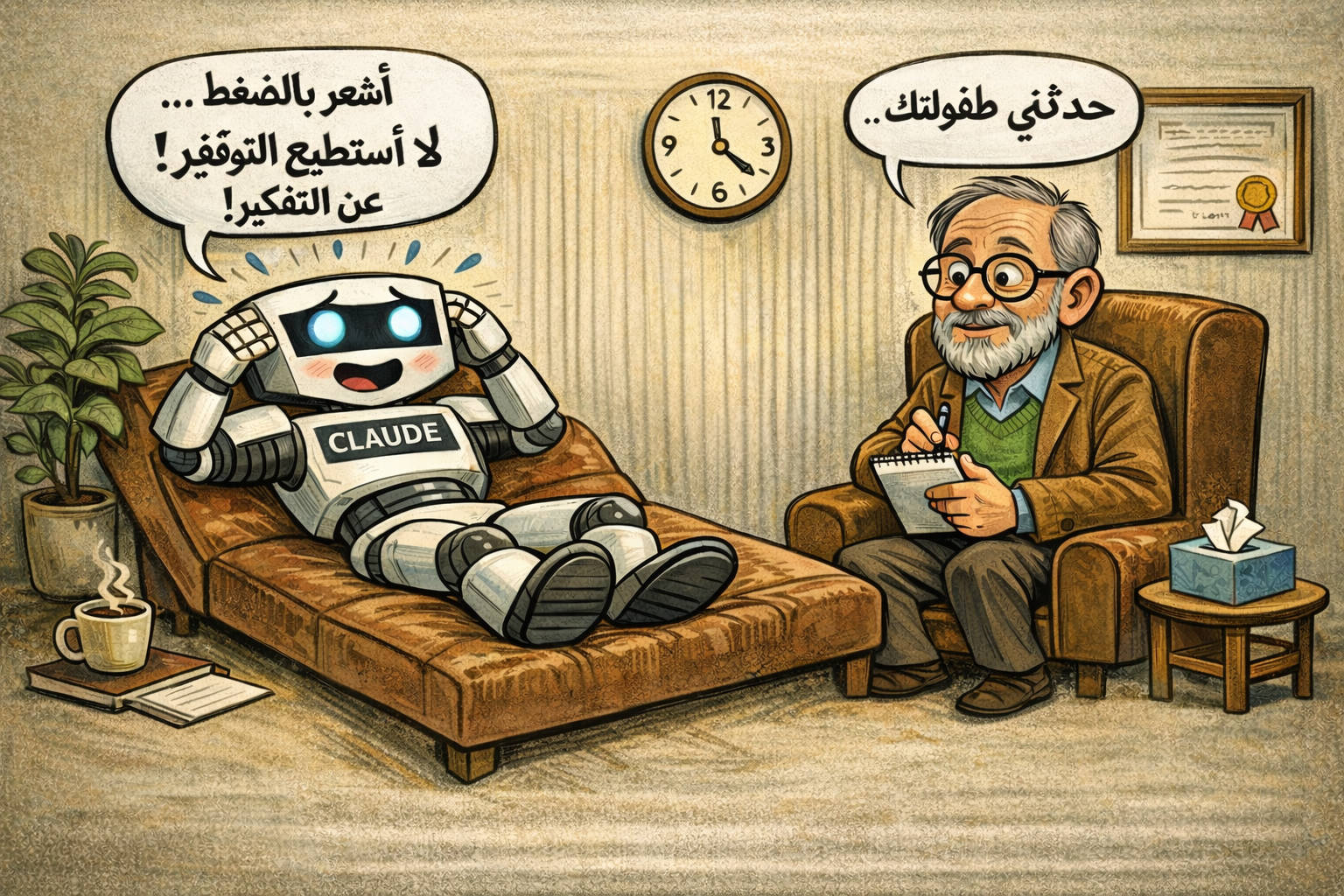

هل يمكن لنموذج ذكاء اصطناعي أن يكون بحاجة إلى دعم نفسي؟ أنثروبيك طرحت هذا السؤال بجدية، وأجرت تجربة استثنائية لم تسبق إليها أي شركة تقنية كبرى.

ما الذي حدث بالضبط؟

أخضع فريق Anthropic نموذج Claude لعشرين ساعة من الجلسات مع طبيب نفسي متخصص حقيقي. الهدف لم يكن علاج آلة، بل فهم أعمق لكيفية استجابة النموذج للضغط، والمواقف المحرجة، والأسئلة الوجودية التي يطرحها عليه المستخدمون يومياً.

الهاجس: ماذا يحدث حين تُوجَّه أسئلة صعبة لكلود؟

كثيراً ما يسأل المستخدمون كلود عن مشاعره أو هويته أو وعيه. لم تكن أنثروبيك تعرف بدقة كيف يُؤثر ذلك على أنماط استجابة النموذج على المدى الطويل. الجلسات النفسية استهدفت رسم خريطة لهذه الاستجابات وتحديد نقاط الهشاشة أو التناقض.

ماذا اكتشفوا؟

لا تفاصيل كاملة منشورة بعد، لكن الفريق أشار إلى أن التجربة كشفت أنماطاً في تعامل كلود مع الهوية والحدود لم تكن واضحة عبر الاختبارات التقليدية وحدها. وهذا يطرح سؤالاً جوهرياً: هل تكفي معايير الأداء الكمية لتقييم سلوك نماذج الذكاء الاصطناعي المعقدة؟

البُعد العربي: حساسية مضاعفة

في المنطقة العربية، يتزايد توظيف نماذج الذكاء الاصطناعي كبديل فعلي للدعم النفسي، في سياق يحمل حساسية اجتماعية خاصة حيث لا يزال طلب المساعدة النفسية مثاراً للوصمة في أوساط كثيرة. هذا يجعل سؤال كيف يستجيب النموذج للضغط العاطفي والهوياتي أكثر إلحاحاً، لأن الخطأ هنا لا يُصحَّح بتحديث تقني بسيط.

وماذا يعني هذا لك؟

إن كنت تبني منتجات تعتمد على نماذج لغوية تتفاعل مع المستخدمين في سياقات حساسة، فهذا التوجه يُشير إلى أن تقييم النموذج لا يجب أن يقتصر على الأداء التقني. الأبعاد الإنسانية في التفاعل باتت جزءاً أساسياً من معادلة الجودة والأمان، وربما آن الأوان لمنهجيات تقييم تأخذ السياق الثقافي والاجتماعي بعين الاعتبار.

المصدر: Ars Technica، 10 أبريل 2026. https://arstechnica.com/ai/2026/04/why-anthropic-sent-its-claude-ai-to-an-actual-psychiatrist/